Concept-clé

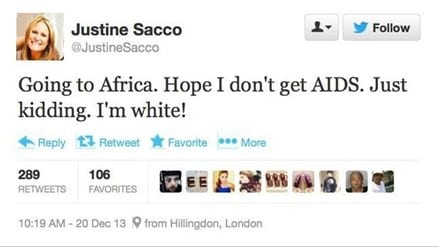

La shitstorm est une forme de lapidation digitale exercée par un groupe de personnes qui se liguent afin de mener une « campagne » d’indignation en ligne contre un individu, contre une entreprise, etc. Débutant toujours par des propos qui font controverses ou des actions qui transgressent les normes sociales (qu’elles soient réelles ou supposées), un « terrorisme psychologique » collectif et coordonné va alors être enclenché en représailles.

Ce néologisme créé par les médias (qui pourrait se traduire par l’expression « tempête de merde ») cherche à démontrer le cataclysme de réactions négatives et violentes déclenchées simultanément qui submergent les personnes ciblées. En effet, leur but premier vise à orchestrer une attaque pour accabler la victime par des propos clairement hostiles et réprobateurs, de manière à publiquement l’humilier, voire la neutraliser.

De manière à ce que le raid en ligne soit très percutant et exacerbe les réactions du grand public, les propos (ou actions) qui font polémiques sont souvent sortis de leur contexte d’énonciation, déformés et surinterprétés. Ainsi plus la vindicte est virale, plus la manifestation de haine gagne en ampleur et ne peut être endiguée.

Synonymes

- Raid numérique

- Raid en ligne

- Attaque coordonnée en ligne

- Dogpiling

- Hashtag poisoning

- Hashtag toxique

Menaces de viol, de mort, incitations au suicide… ça a été un déferlement de haine en quelques minutes !

– une victime

Ce qu’il faut retenir…

Ces cohortes de haine peuvent tout d’abord avoir recours à la technique du « dogpiling », au cours de laquelle un grand nombre de comptes (donc d’agresseurs) vont alimenter soudainement le fil de commentaires d’un article, d’un post, etc., avec des critiques ouvertes et/ou des insultes virulentes. Ce bombardement est si intense et fulgurant qu’il peut parfois saturer la plateforme et la rendre inutilisable jusqu’à ce que l’attaque soit terminée.

Pour coordonner leurs attaques, elles utilisent un « dog whistle » (un sifflet à chien), un langage codé ou suggestif, comme des mots ou des symboles avec une signification double, afin de signaler au groupe d’agresseurs en ligne d’attaquer la cible spécifique à un instant donné, sans pour autant éveiller les soupçons.

Elles peuvent également avoir recours à un « hashtag toxique » (également appelé « hashtag poisoning ») qui consiste en la création d’un hashtag abusif ou au détournement d’un hashtag déjà existant afin de l’utiliser comme un cri de ralliement pour dénigrer, humilier et intimider une victime ciblée, qui a exprimé des opinions sur des sujets sensibles ou des idées que les assaillants en ligne désapprouvent, voire prennent hors contexte afin de promouvoir un agenda particulier.

Par extension, cette pratique d’attaque coordonnée en ligne peut également faire l’objet d’une technique récupérée à des fins politiques ou marketing qui s’appelle « l’astroturfing ». On peut également la trouver sous le terme de « similantisme » ou « contrefaçon de mouvement d’opinion ». Elle vise principalement à véhiculer un message en donnant l’impression d’un phénomène de masse citoyen (« grassroots movements »), qui émerge de façon spontanée, alors qu’en réalité, il a été créé de toutes pièces pour influencer l’opinion publique.

Aux origines

Le terme d’astroturfing a été utilisé la première fois en 1985 par le sénateur démocrate Lloyd Bentsen, qui a détourné le sens attribué au produit phare de la marque américaine AstroTurf : un gazon artificiel imitant parfaitement la pelouse naturelle et commercialisé à grande échelle dans tout le pays. L’élu était inondé à l’époque de nombreux courriers d’expéditeurs fictifs dont l’objectif premier était de protéger les intérêts de certaines compagnies d’assurance.

En faisant le parallèle avec le gazon synthétique et la pelouse naturelle, il voulait simplement opposer la force d’une vraie mobilisation citoyenne pour influencer l’opinion publique aux tentatives peu scrupuleuses de certaines entreprises, voire de certains partis politiques, qui n’hésitaient pas à usurper une identité citoyenne pour simuler un mouvement spontané ou populaire autour de leur cause.

De grands groupes pharmaceutiques, cigarettiers, ou encore pétroliers peu consciencieux s’étaient particulièrement distingués en constituant des alliances avec des groupes de citoyens déjà existants, en les finançant profusément, dans le seul but de créer de faux groupes d’intérêt public pour asseoir leur ascendance.

Depuis, les techniques d’astroturfing se sont modernisées, facilitées par un accès à des outils technologiques permettant de lancer avec peu de moyens des campagnes de lobbying majeures. Faux comptes, contributions générées par des robots ou par des algorithmes, le web est devenu un terrain idéal pour la prolifération de ces phénomènes.

Exemple concret

Que dit le cadre légal…

Adoption le 13 mai 2020 d’une proposition de loi qui vise à lutter contre la propagation des discours de haine sur Internet portée par la députée Laëtitia Avia (la « loi Avia ») :

- l’article 1 définit un nouveau régime de responsabilité administrative applicable aux opérateurs de plateformes qui leur impose de retirer ou de rendre inaccessible des contenus dits « haineux » dans un délai maximal de 24 heures après notification par tout internaute ;

- l’article 3 contraint les opérateurs de plateformes à communiquer une information claire sur les voies de recours, y compris judiciaires, à leur disposition ;

- l’article 4 donne au Conseil supérieur de l’audiovisuel les compétences nécessaires pour exercer les missions de supervision (possibilité d’émettre des recommandations pour mieux accompagner les opérateurs de plateformes dans l’identification des contenus illicites) ;

- l’article 5 renforce la coopération entre les opérateurs de plateformes et les autorités judiciaires en matière d’identification des auteurs de contenus illicites.

Pour aller un peu plus loin…

Quelques références scientifiques :

- Austin Andrew, How the West Is Won: Astroturf Lobbying and the “Wise Use” Movement, The American Prospect, vol. 25, 1996, p. 37-42.

- Bloch Emmanuel, La communication asymétrique : proposition de cadre méthodologique de décryptage des mouvements activistes et des déstabilisations informationnelles, Revue internationale d’intelligence économique, vol. 13, n° 1, 2021, p. 77-92.

- Boulay Sophie, Exploration du phénomène d’astroturfing : une stratégie de communication usurpant l’identité citoyenne dans l’espace public, Revue internationale de communication sociale et publique, n° 7, 2012, p. 61‑84, [https://doi.org/10.4000/communiquer.487].

- Galyashina Elena, Nikishin Vladimir, The Concepts of Aggressive Information Impact through the Lensof Internet Users’ Worldview Security, Journal of Siberian Federal University Humanities & Social Sciences, vol. 14, 2021, p. 1660-1673, [https://doi.org/10.17516/1997-1370-0848].

- Klotz Robert J., Internet Campaigning for Grassroots and Astroturf Support, Social Science Computer Review, vol. 25, n° 3, 2007, p. 3-12, [https://doi.org/10.1177/0894439306289105].

- Lyon Thomas P., John H. Maxwell, Astroturf : Interest Group Lobbying and Corporate Strategy, Journal of Economics and Management Strategy, vol. 13, n° 4, p. 561‑597, [https://doi.org/10.1111/j.1430-9134.2004.00023.x].

- McNutt John, Boland Katherine, Astroturf, technology and the future of community mobilization: implications for nonprofit theory, Journal of Sociology and Social Welfare, vol. 34, n° 3, 2007, [https://doi.org/10.15453/0191-5096.3278].

- Vanderbiest Nicolas, Les institutions démocratiques : l’influence des réseaux sociaux durant une élection présidentielle », in : Taillat Stéphane, La Cyberdéfense, Paris, Armand Colin, coll. « Collection U », 2018, p. 181‑188, [https://doi.org/10.3917/arco.danet.2018.01.0181].

- Weber Derek, Neumann Frank, Amplifying influence through coordinated behaviour in social networks, Social Network Analysis and Mining, vol. 11, n° 1, 2021, 111 pages, [https://doi.org/10.1007/s13278-021-00815-2].